Description

Llama 2 herunterladen – Kostenloses, Open‑Source KI‑Chat‑Modell für Windows, Mac, Linux, Android & iOS

Übersicht

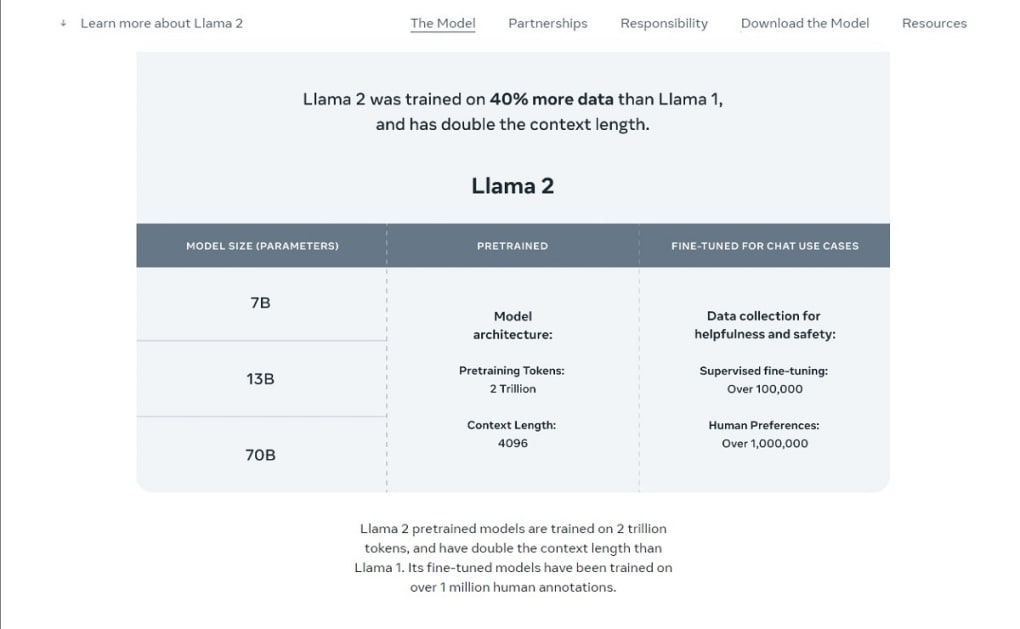

Llama 2 ist das neueste Open‑Source‑Großsprachenmodell (LLM) von Meta, das modernste konversationelle KI für jeden bereitstellt, der ein kostenloses, sicheres und hoch anpassungsfähiges Werkzeug wünscht. Auf Basis von 2 Billionen Tokens gebaut und mit 40 Prozent mehr Daten trainiert als sein Vorgänger, liefert Llama 2 reichhaltigere, nuanciertere Antworten und bewahrt dabei eine benutzerfreundliche Oberfläche. Egal, ob Sie ein Entwickler sind, der einen leistungsstarken Chatbot in eine App integrieren möchte, ein Forscher, der eine Sandbox für Experimente mit natürlicher Sprache benötigt, oder einfach ein neugieriger Nutzer, der mit einer KI chatten will – Llama 2 bietet eine überzeugende Mischung aus Geschwindigkeit, Genauigkeit und Flexibilität. Das Kontextfenster des Modells wurde verdoppelt, sodass es längere Gespräche oder größere Code‑Snippets verfolgen kann, und es wurde mit mehr als einer Million von Menschen erzeugter Konnotationen feinabgestimmt, um die Feinheit seiner Antworten zu verbessern. Sie können Llama 2 sofort über eine Online‑Demo ausprobieren oder das native Paket nach einer schnellen Registrierung herunterladen. Obwohl das Modell noch gelegentliche Kürzungen oder kleinere faktische Fehler zeigt – gängige Herausforderungen für jedes LLM – übertrifft es bereits viele kommerzielle Alternativen in Bezug auf Offenheit und Kosten. Kurz gesagt, Llama 2 ist ein kostenlos zu nutzendes, sicheres KI‑Chat‑Modell, das durch Community‑Beiträge und Metas fortlaufende Forschungspipeline kontinuierliche Verbesserungen verspricht.

Hauptfunktionen von Llama 2

- Open‑Source & Kostenlos: Vollständig verfügbar unter einer permissiven Lizenz, die Modifikation und Weiterverteilung ohne versteckte Gebühren erlaubt.

- Massiver Trainingskorpus: Auf 2 Billionen Tokens trainiert und bietet eine breitere Wissensabdeckung als die meisten öffentlichen LLMs.

- Erweiterte Kontextlänge: Doppelt so großes Token‑Fenster wie Llama 1, ermöglicht längere Dialoge und komplexere Code‑Generierung.

- Menschzentriertes Fine‑Tuning: Über eine Million menschlicher Konnotationen integriert, um Ton, Relevanz und Sicherheit zu verbessern.

- Plattformübergreifende Verfügbarkeit: Native Binärdateien für Windows, macOS, Linux, Android und iOS sowie eine webbasierte Demo.

- Code‑Generierungsfähigkeit: Unterstützt mehrere Programmiersprachen; kann auf Abruf Code‑Snippets schreiben, debuggen und erklären.

- Sicher & Privat: Läuft lokal auf Ihrem Gerät und stellt sicher, dass Eingaben Ihr Gerät nie verlassen, es sei denn, Sie aktivieren ausdrücklich Cloud‑Dienste.

- Regelmäßige Updates: Meta veröffentlicht häufige Patches und Modellverbesserungen, sodass die KI mit der neuesten Forschung auf dem Laufenden bleibt.

- Einfache Integration: Bietet REST‑API‑Endpunkte und Python‑Bindings für Entwickler, die Llama 2 in ihre Anwendungen einbetten möchten.

- Community‑gesteuertes Ökosystem: Eine lebendige GitHub‑Community trägt Plugins, feinabgestimmte Varianten und Dokumentation bei.

Installation, Nutzungsanleitung & Kompatibilität

Schritt‑für‑Schritt‑Installation

1. Registrieren Sie sich für ein kostenloses Konto im offiziellen Llama 2‑Portal. Nach der Verifizierung erhalten Sie einen Download‑Link für Ihr Betriebssystem.

2. Laden Sie das passende Paket herunter: Windows‑Nutzer erhalten einen .exe‑Installer, macOS‑Nutzer eine .dmg‑Datei, Linux‑Nutzer ein .tar.gz‑Archiv, und mobile Nutzer die App aus Google Play oder dem App Store.

3. Führen Sie das Installationsprogramm aus: Folgen Sie den Bildschirmanweisungen. Das Installationsprogramm richtet automatisch die erforderlichen Abhängigkeiten ein, wie Python 3.10, CUDA (falls Sie eine NVIDIA‑GPU besitzen) und eine leichte SQLite‑Datenbank für lokales Caching.

4. Überprüfen Sie die Installation: Öffnen Sie ein Terminal oder die Eingabeaufforderung und geben Sie llama2 --version ein. Sie sollten die aktuelle Versionsnummer und eine Bestätigung sehen, dass die Modelldateien geladen sind.

5. Optionale GPU‑Beschleunigung: Wenn Ihr System CUDA unterstützt, aktivieren Sie es in der Datei config.yaml, indem Sie use_gpu: true setzen. Dies kann die Inferenzgeschwindigkeit um bis zu das Vierfache steigern.

Erstmalige Nutzung

Nach der Installation starten Sie den Llama 2‑Desktop‑Client oder die Web‑Demo. Sie werden von einem klaren Eingabefeld begrüßt, in das Sie jede Eingabe tippen können – Fragen, kreative Schreibaufgaben oder Code‑Snippets. Drücken Sie Enter und das Modell erzeugt in Echtzeit eine Antwort. Für Entwickler bietet der CLI‑Befehl llama2 chat "Your prompt here" eine schnelle Möglichkeit, das Modell ohne GUI zu testen. Der API‑Endpunkt POST /v1/completions folgt dem OpenAI‑Schema und ermöglicht eine nahtlose Migration von anderen Diensten.

Unterstützte Betriebssysteme

- Windows 10 / 11 (64‑Bit)

- macOS 12 Monterey und neuer (Apple Silicon & Intel)

- Linux‑Distributionen mit glibc 2.27+ (Ubuntu 20.04, Fedora 34 usw.)

- Android 8.0+ (ARM64)

- iOS 13+ (iPadOS enthalten)

Llama 2 erkennt während der Installation automatisch Ihre Plattform und konfiguriert die optimale Laufzeit. Wenn Sie Kompatibilitätswarnungen erhalten, konsultieren Sie den Troubleshooting‑Leitfaden auf der offiziellen Website, der gängige Probleme wie fehlende CUDA‑Treiber oder veraltete Python‑Pakete behandelt.

Vor‑ und Nachteile, Häufig gestellte Fragen und Experten‑Review

Vorteile

- Vollständig kostenlos und Open‑Source, eliminiert Lizenzgebühren.

- Großer Trainingsdatensatz liefert breiteres Wissen und besseres Sprachverständnis.

- Erweitertes Kontextfenster verbessert mehrstufige Gespräche und Code‑Verarbeitung.

- Läuft lokal und bietet eine datenschutz‑first Interaktion.

- Plattformübergreifende Unterstützung gewährleistet Zugänglichkeit auf Desktops und mobilen Geräten.

- Aktive Community liefert Erweiterungen, feinabgestimmte Modelle und schnelle Fehlerbehebungen.

Nachteile

- Gelegentliche faktische Ungenauigkeiten, typisch für generative LLMs.

- Antworten können abgeschnitten werden, wenn Eingaben das Kontextlimit überschreiten.

- GPU‑Beschleunigung erfordert kompatible Hardware und korrekte Treiberinstallation.

- Die Dokumentation verbessert sich zwar, bleibt aber hinter einigen kommerziellen Alternativen zurück.

- Erweiterte Anpassungen (z. B. benutzerdefiniertes Fine‑Tuning) können tiefere ML‑Kenntnisse erfordern.

FAQ – Häufig gestellte Fragen

Ist Llama 2 wirklich kostenlos für kommerzielle Projekte nutzbar?

Ja. Llama 2 wird unter einer permissiven Lizenz veröffentlicht, die sowohl private als auch kommerzielle Nutzung ohne Lizenzgebühren erlaubt. Sie sollten jedoch die spezifische Lizenzdatei auf etwaige Namensnennungsanforderungen prüfen.

Kann ich Llama 2 auf einem Low‑End‑Laptop ohne GPU ausführen?

Absolut. Llama 2 enthält CPU‑optimierte Inferenzpfade, obwohl die Leistung im Vergleich zu GPU‑beschleunigten Setups langsamer ist. Für leichte Nutzung (kurze Eingaben) reicht ein modernes Laptop aus.

Wie oft aktualisiert Meta das Modell?

Meta veröffentlicht größere Updates etwa alle 3‑4 Monate, dazwischen kleinere Sicherheitspatches und Daten‑Refresh‑Releases. Alle Updates sind kostenlos und können über den integrierten Updater installiert werden.

Gibt es eine Möglichkeit, Llama 2 mit eigenen Daten zu fine‑tunen?

Ja. Das Open‑Source‑Repository stellt Skripte für überwachtes Fine‑Tuning bereit. Sie benötigen eine kompatible GPU und einen Datensatz im JSONL‑Format, aber die Community bietet Schritt‑für‑Schritt‑Anleitungen.

Welche Datenschutzmaßnahmen bietet Llama 2?

Da das Modell lokal läuft, verlassen Ihre Eingaben nie das Gerät, es sei denn, Sie aktivieren ausdrücklich Cloud‑Logging. Die Software verschlüsselt zudem zwischengespeicherte Daten und bietet die Möglichkeit, Telemetrie abzulehnen.

Experten‑Review

Rating: 4.5/5

Llama 2 zeichnet sich als das zugänglichste Hochleistungs‑LLM für Entwickler und Hobbyisten gleichermaßen aus. Seine Open‑Source‑Natur beseitigt die Hürde teurer API‑Abonnements, während das erweiterte Kontextfenster und das menschzentrierte Fine‑Tuning spürbar flüssigere Gespräche ermöglichen. Die Hauptnachteile – gelegentliche Halluzinationen und der Bedarf an ordentlicher Hardware für optimale Geschwindigkeit – sind branchenweit üblich und überwiegen nicht die Vorteile. Insgesamt ist Llama 2 eine solide, zukunftssichere Wahl für alle, die konversationelle KI integrieren möchten, ohne Kompromisse bei Datenschutz oder Budget einzugehen.

Fazit & Handlungsaufruf

Wenn Sie auf ein leistungsstarkes, aber kostenloses KI‑Chat‑Modell gewartet haben, das Ihre Privatsphäre respektiert und auf allen wichtigen Plattformen funktioniert, erfüllt Llama 2 alle Kriterien. Sein großzügiges Token‑Limit, die Open‑Source‑Lizenz und das robuste Funktionsset machen es zu einer hervorragenden Alternative zu kommerziellen Diensten, die pro Anfrage kosten. Egal, ob Sie einen Kunden‑Support‑Bot bauen, mit Code‑Generierung experimentieren oder einfach die Fähigkeiten moderner KI erkunden möchten, Llama 2 bietet eine zuverlässige Grundlage, die mit Ihren Bedürfnissen wachsen kann. Verpassen Sie nicht die Gelegenheit, die neueste Version noch heute herunterzuladen – registrieren Sie sich auf der offiziellen Seite, wählen Sie Ihr Betriebssystem und beginnen Sie, mit einem der fortschrittlichsten kostenlosen Sprachmodelle zu chatten.

Llama 2 jetzt herunterladen and join the thriving community that’s shaping the next generation of conversational AI.

Guides & Tutorials for Llama 2

How to install Llama 2

- Click the Preview / Download button above.

- Once redirected, accept the terms and click Install.

- Wait for the Llama 2 download to finish on your device.

How to use Llama 2

This software is primarily used for its core features described above. Open the app after installation to explore its capabilities.

User Reviews for Llama 2 0

No reviews found